貴大新聞網(wǎng)訊(計算機科學(xué)與技術(shù)學(xué)院)近日,貴州大學(xué)文本計算與認知智能教育部工程研究中心科研團隊題為 Exclusion of Thought: Mitigating Cognitive Load in Large Language Models for Enhanced Reasoning in Multiple-Choice Tasks 的研究論文被自然語言處理領(lǐng)域頂級國際會議ACL 2025 (The 63nd Annual Meeting of the Association for Computational Linguistics,CCF-A類) 錄用。這是我省高校及科研機構(gòu)首篇被ACL錄用的論文,也是我省大語言模型(Large Language Models, LLMs)領(lǐng)域首篇國際頂級會議論文,標(biāo)志著貴州大學(xué)在認知智能與自然語言理解研究方面取得了重要突破。論文第一作者為我校計算機科學(xué)與技術(shù)學(xué)院2023級研究生付啟航,通訊作者為秦永彬教授和黃瑞章教授。

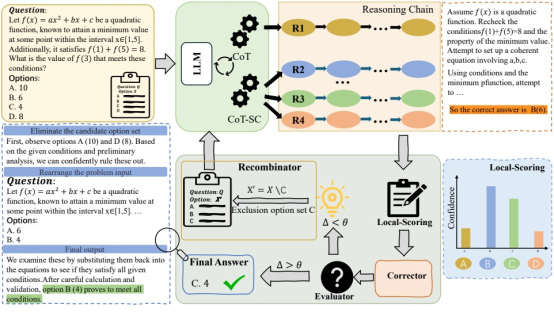

隨著以GPT-4、DeepSeek等為代表的大語言模型技術(shù)迅速發(fā)展,LLMs已成為當(dāng)前人工智能領(lǐng)域的核心研究方向之一。依托海量參數(shù)與強大的語言建模能力,LLMs在文本生成、問答、翻譯等多個自然語言處理任務(wù)中展現(xiàn)出卓越表現(xiàn)。然而在面對多項選擇題任務(wù)時LLMs往往會受到錯誤選項的影響,錯誤的選項會對模型的理解和推理能力產(chǎn)生“認知負擔(dān)”,導(dǎo)致LLMs時常給出看似正確但實則錯誤的答案。為應(yīng)對這一難題,本文提出了模擬人類思維方式的大語言模型推理方法,簡稱Exclusion of Thought(EoT),該方法通過引導(dǎo)大語言模型主動排除錯誤選項,從而有效降低外部干擾對模型推理路徑的影響,顯著減輕其“認知負擔(dān)”。同時,EoT策略通過記錄模型的排除過程,增強了其推理過程的透明性與可解釋性,為解決當(dāng)前人工智能“黑盒問題”提供了新的思路。EoT作為一種即插即用的方法,可以與現(xiàn)有的任何一種提示策略相結(jié)合。本文在6個多項選擇題數(shù)據(jù)集和5個熱門的LLM上進行了廣泛而全面的實驗。結(jié)果顯示,EoT顯示出一致的性能提升,在傳統(tǒng)方法表現(xiàn)欠缺的復(fù)雜推理任務(wù)上提升更為明顯。

此次論文成功入選ACL主會,充分展示了貴州大學(xué)在人工智能領(lǐng)域、特別是認知智能與語言推理方面的科研實力,也彰顯了近年來學(xué)校強化計算機科學(xué)學(xué)科及人工智能科研團隊建設(shè)的成效。貴州大學(xué)文本計算與認知智能科研團隊最早組建于2008年,經(jīng)過十幾年的建設(shè)與發(fā)展,形成了從事文本挖掘與分析、自然語言處理、知識融合、認知智能、醫(yī)學(xué)影像、數(shù)據(jù)智能等相關(guān)研究的特色科研團隊,2022年獲批文本計算與認知智能教育部工程研究中心,目前聚焦互聯(lián)網(wǎng)文本分析、認知分析、法律大模型、智慧法院、智慧司法、醫(yī)學(xué)影像分析與精準(zhǔn)診斷等人工智能的交叉領(lǐng)域開展研究與應(yīng)用。

編輯:張蟬

責(zé)編:李旭鋒

編審:丁龍